Dans une architecture complète Cloud tout en services managés, Azure Databricks est extrêmement efficace pour se connecter aux données des comptes de stockage Azure : Blob Storage, Data Lake Store gen1 ou gen2.

Pour autant, il n’est pas raisonnable d’utiliser la solution de facilité et de se connecter au travers des commandes suivantes (exemple en Python) :

storage_account = "<nom de votre ressource Azure Storage>"

container = "<nom du container souhaité>"

storage_account_access_key = <"iciuneclévisiblecequilnefautjamaisfaire!">

dbutils.fs.mount(

source = "wasbs://"+container+"@"+storage_account+".blob.core.windows.net",

mount_point = "/mnt/"+container,

extra_configs = { "fs.azure.account.key."+storage_account+".blob.core.windows.net": storage_account_access_key })

La procédure permettant de cacher les informations de sécurité est relativement simple, la voici en détails.

Databricks CLI

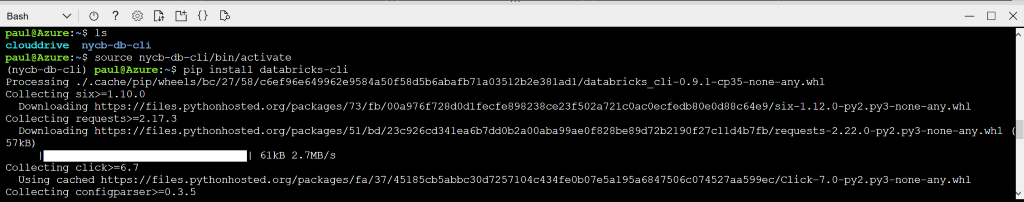

Le principe est de créer des secret scopes, au moyen de l’interface de lignes de commandes (CLI) de Databricks. Celle-ci s’obtient au travers de l’installation d’un package python.

pip install databricks-cli

Pour une première utilisation, il est nécessaire d’associer l’espace de travail Azure Databricks avec le poste où sera exécuté le CLI. Une fois le package installé, saisir la commande suivante :

databricks configure --token

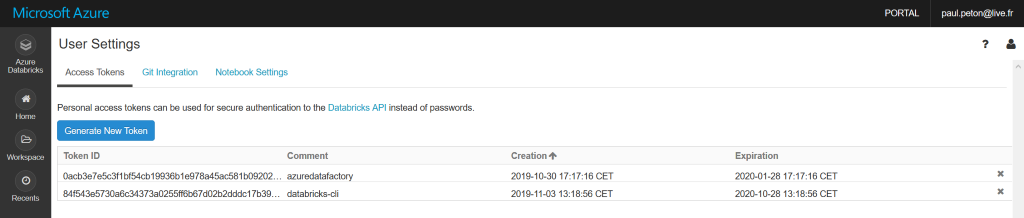

Deux informations sont alors attendues : l’URL du service managé puis un jeton d’identification préalablement créé depuis l’espace de travail Databricks, à partir du menu Users settings > Access tokens.

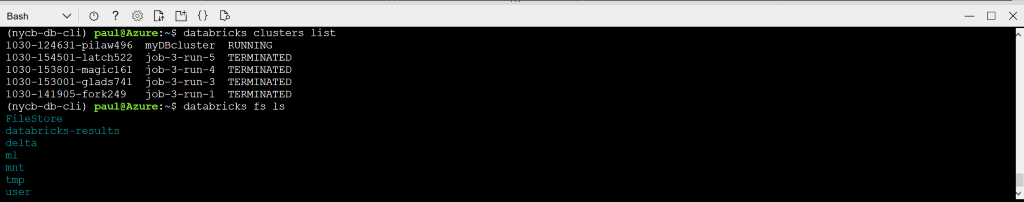

Les commandes du package sont maintenant en interaction avec la ressource Databricks, en voici quelques exemples :

databricks workspace ls databricks clusters spark-versions databricks fs ls dbfs:/delta/

Créer un secret scope

Passons maintenant aux commandes qui définiront le secret scope (un scope peut contenir plusieurs informations secrète).

databricks secrets create-scope --scope scopeAzStorage databricks secrets put --scope scopeAzStorage --key accessKeyAzStorage

La seconde commande ouvre alors un éditeur de texte, type VI, dans lequel on copiera par exemple l’access key d’un Azure Blob Storage.

Créer (proprement) un point de montage

Voici maintenant le code Python que l’on exécutera dans un notebook pour définir un point de montage, c’est-à-dire un accès simplifié aux fichiers contenu sur un compte de stockage Azure, ici en reprenant le nom du container dans le chemin d’accès.

dbutils.fs.mount(

source = "wasbs://"+container+"@"+storage_account+".blob.core.windows.net/",

mountPoint = "/mnt/"+container,

extra_configs = { "fs.azure.account.key."+storage_account+".blob.core.windows.net" :dbutils.secrets.get(scope = "scopeAzStorage" , key = "accessKeyAzStorage" )})

A vous maintenant les commandes magiques… et ceci, en toute sécurité !

%fs ls /mnt/

(Cet article détaille par écrit la vidéo disponible ici.)

Bonjour,

Merci pour l’article.

J’ai tester et ça fonctionne très bien.

Il me semble qu’il manque les guillemets pour le nom du scope et de la clé:

dbutils.secrets.get(scope = “scopeAzStorage” , key = “accessKeyAzStorage” )

Ensuite, j’ai testé ça: https://docs.microsoft.com/fr-fr/azure/databricks/security/secrets/secret-scopes#create-an-azure-key-vault-backed-secret-scope

C’est en public preview et visiblement, ce n’est pas encore disponible dans databricks cli mais ça fonctionne bien aussi 🙂

Merci, j’ai ajouté les guillemets dans le code de l’article.